个人简介

胡一涛,天津大学智能与计算学部,教授,天津市TANKLAB实验室李克秋教授团队成员。博士毕业于美国南加州大学,导师为Ramesh Govindan教授。本科毕业于上海交通大学,导师为王新兵教授。研究方向包括大语言模型(LLM)系统、生成检索增强(RAG)和 AI for Science (AI4Science)。近期主要致力于大语言模型和 AI4Science 应用在云端 GPU 集群的部署与推理优化,旨在通过计算加速、并行优化和资源编排等技术实现高性能、高效率和高可扩的人工智能系统。通过与 IBM Watson 研究院、三星研究院、微软研究院等研究机构的合作,在 Nature、ASPLOS、EuroSys、SoCC、Ubicomp、INFOCOM、IWQoS、SIGCOMM、TPDS 和 TC 等高水平会议/期刊上发表论文三十余篇。研究获得NSFC等机构资助,并获得天津大学 U35 优秀青年人才奖、ACM SoCC'24 最佳论文奖等荣誉。

带领团队开发了高校问答大模型“天问”(Twen.ai)。基于RAG检索增强技术,天问在学习生活、升学就业、科研学术、奖学金申请等方面为天大师生提供咨询服务。天问于24年4月正式发布,每日服务数千咨询问题。近期,配合推动建设天津大学 AI 辅导员“小天老师”,小天老师已于25年9月全校官方上线,实现 AI 赋能学生成长。

欢迎有自驱力、编程能力强、对大语言模型系统和 AI4Science 感兴趣的学生与我邮件联系。请邮件附上简历/简介!

研究内容

目前我主要研究大语言模型和 AI4Science 应用在云端 GPU 集群的部署与推理优化,旨在实现高性能、高效率和高可扩的人工智能系统。

-

大语言模型(LLM)系统

-

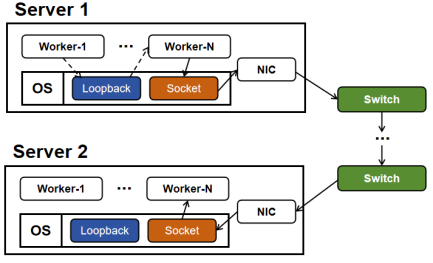

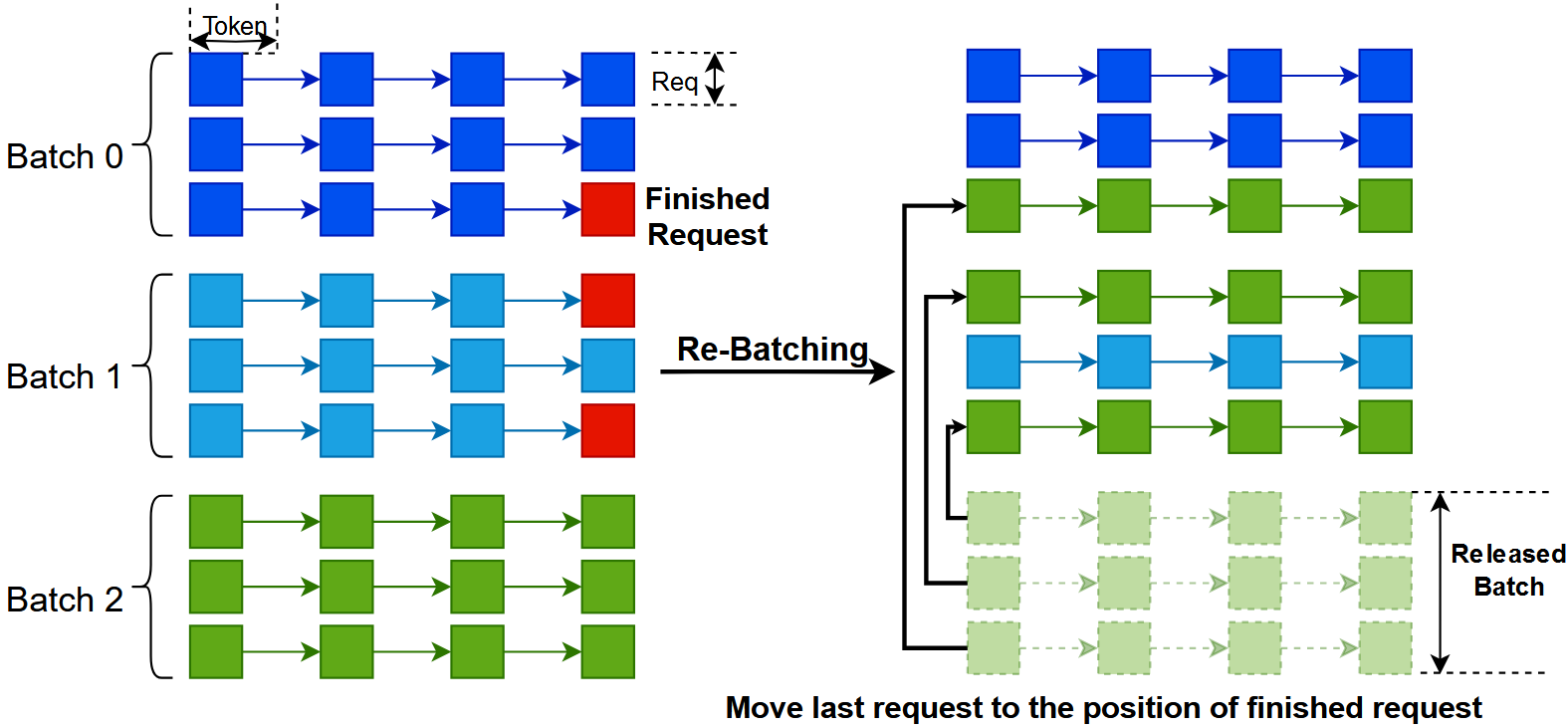

大模型推理服务:巨大的内存消耗和不可预测的输出长度,为 LLM 应用带来了新的挑战。 我们设计了 LLM 推理系统(qLLM、tgLLM),降低了 LLM 请求的作业完成时间,并提高了模型吞吐量和资源利用率。 我们还构建了多个推理系统(InferRAG、InferMM)来管理 RAG 和多模态等场景下的GPU计算资源。

-

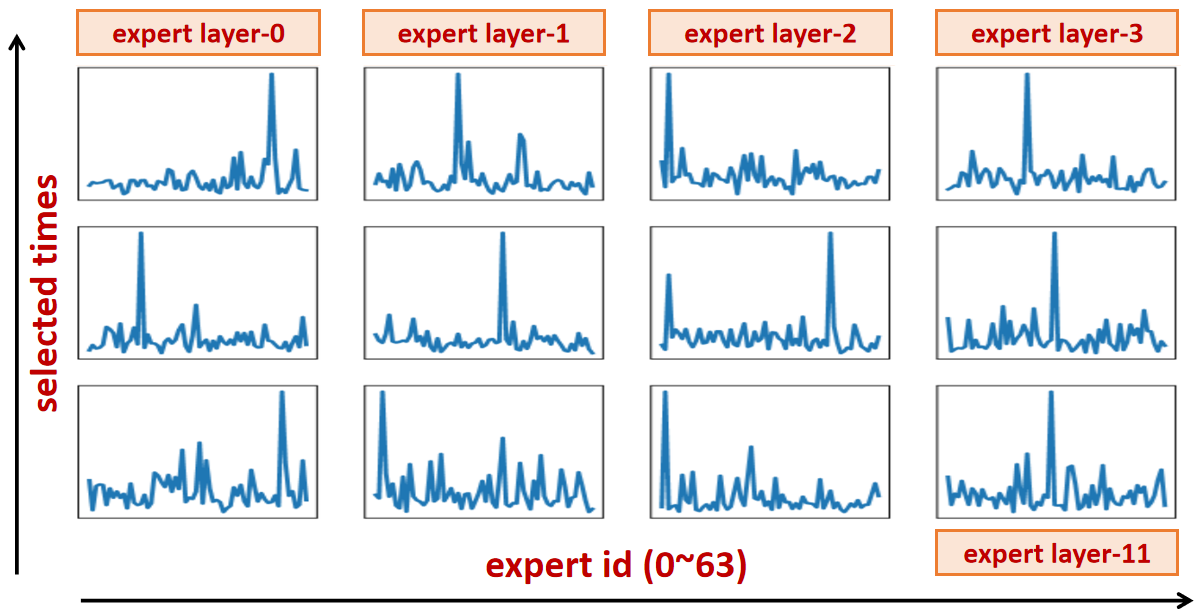

大模型架构及应用: 近期 LLM 架构的创新也带来了新的挑战。我们设计了推理系统(SuperSpec、ParaMoE)来优化推测解码和混合专家的推理效率。此外,我们还研究了前向解码、LoRA 服务、kv-cache 压缩等优化问题。

-

大模型推理服务:巨大的内存消耗和不可预测的输出长度,为 LLM 应用带来了新的挑战。 我们设计了 LLM 推理系统(qLLM、tgLLM),降低了 LLM 请求的作业完成时间,并提高了模型吞吐量和资源利用率。 我们还构建了多个推理系统(InferRAG、InferMM)来管理 RAG 和多模态等场景下的GPU计算资源。

-

深度学习(DNN)系统

-

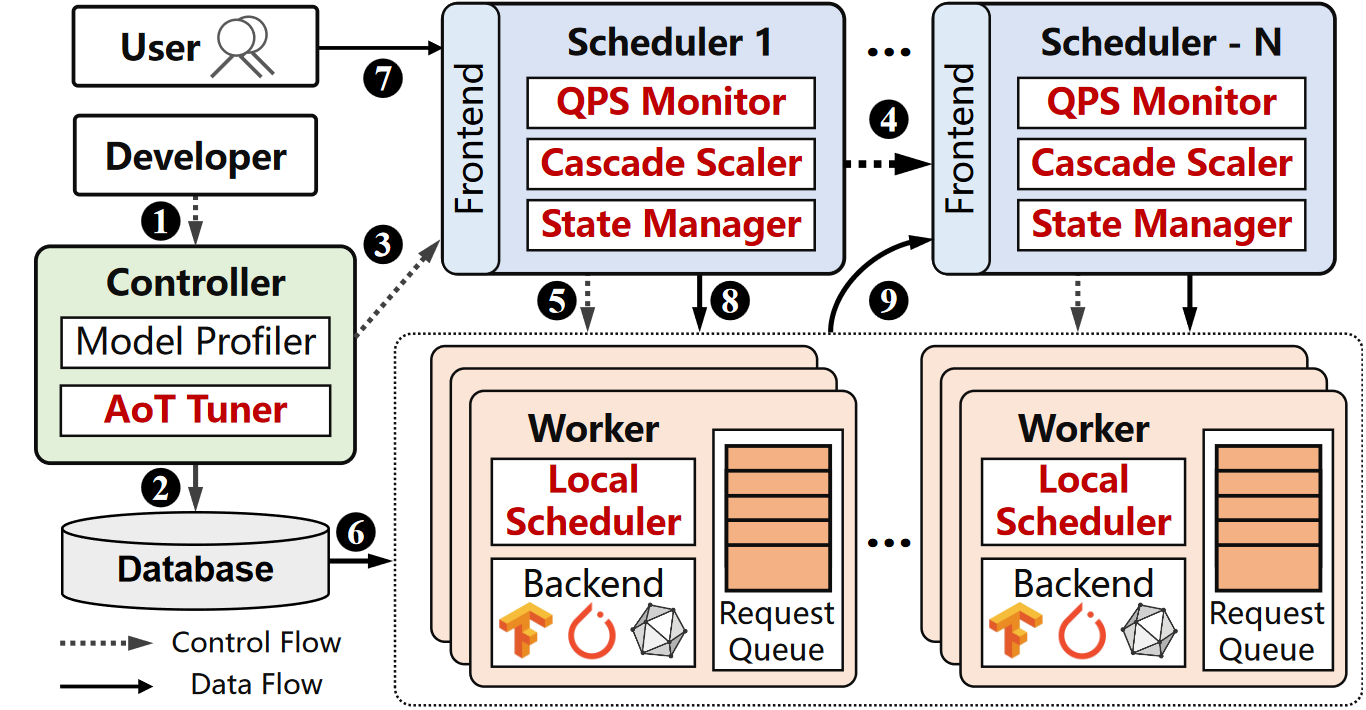

低时延推理服务:为了保证良好的用户体验,基于 DNN 的应用通常有一个时延目标。我们设计了多个 DNN 推理系统(Harpagon、DeepLat、TopInfer),通过动态批处理、请求分派和配置解耦等技术,最大限度地降低了延迟目标下的服务成本。我们还构建了多个弹性扩缩容系统(SLOpt、DeepChain),通过 AoT 编译和模型预热等技术,在突发工作负载下最大化系统吞吐量。

-

低时延推理服务:为了保证良好的用户体验,基于 DNN 的应用通常有一个时延目标。我们设计了多个 DNN 推理系统(Harpagon、DeepLat、TopInfer),通过动态批处理、请求分派和配置解耦等技术,最大限度地降低了延迟目标下的服务成本。我们还构建了多个弹性扩缩容系统(SLOpt、DeepChain),通过 AoT 编译和模型预热等技术,在突发工作负载下最大化系统吞吐量。

代表论文

- [ICML 26] Mosaic: Unlocking Long-Context Inference for Diffusion LLMs via Global Memory Planning and Dynamic Peak Taming [paper]

- [ICML 26] KernelBand: Boosting LLM-based Kernel Optimization with a Hierarchical and Hardware-aware Multi-armed Bandit [paper]

- [EuroSys 26] PARD: Enhancing Goodput for Inference Pipeline via Proactive Request Dropping (CCF-A) [paper]

- [ASPLOS 26] PAT: Accelerating LLM Decoding via Prefix-Aware Attention with Resource Efficient Multi-Tile Kernel (CCF-A) [paper][code][slides]

- [TPDS 26] ViDA: Lossless VideoQA Acceleration via Selective Sparse Self-Speculation with Parallel Computational Load Management (CCF-A) [paper]

- [TPDS 26] Accelerating ML Inference via Opportunistic Pre-Loading on Serverless Clusters (CCF-A) [paper]

- [Nature 25] Delocalized Electrolyte Design Enables 600 Wh kg−1 Lithium Metal Pouch Cells [paper]

- [TC 25] TightLLM: Maximizing Throughput for LLM Inference via Adaptive Offloading Policy (CCF-A) [paper]

- [TC 25] SLOpt: Serving Real-Time Inference Pipeline with Strict Latency Constraint (CCF-A) [paper]

- [INFOCOM 25] Harpagon: Minimizing DNN Serving Cost via Efficient Dispatching, Scheduling and Splitting (CCF-A) [paper]

- [INFOCOM 25] Lark: A Buffer-aware Building Block for Programmable Packet Scheduling in Datacenters (CCF-A) [paper]

- [SoCC 24] Pre-Warming is Not Enough: Accelerating Serverless Inference With Opportunistic Pre-Loading (CCF-B, Best Paper Award) [paper]

- [SIGCOMM 24] PPT: A Pragmatic Transport for Datacenters (CCF-A) [paper]

- [ASPLOS 24] FUYAO: DPU-enabled Direct Data Transfer for Serverless Computing (CCF-A) [paper]

- [IWQoS 23] High-throughput Sampling, Communicating and Training for Reinforcement Learning Systems (CCF-B) [paper]

- [TPDS 23] Accelerating Data Delivery of Latency-Sensitive Applications in Container Overlay Network (CCF-A) [paper]

- [SoCC 21] Scrooge: A Cost-Effective Deep Learning Inference System (CCF-B) [paper]

- [IoTDI 21] Rim: Offloading Inference to the Edge [paper]

- [Middleware 18] Olympian: Scheduling GPU Usage in a Deep Neural Network Model Serving System (CCF-B) [paper]

- [Ubicomp 16] ALPS: Accurate Landmark Positioning at City Scales (CCF-A) [paper]

- [INFOCOM 14] Critical Sensing Range for Mobile Heterogeneous Camera Sensor Networks (CCF-A) [paper]

- [Preprint 26] Mosaic: Unlocking Long-Context Inference for Diffusion LLMs via Global Memory Planning and Dynamic Peak Taming [paper]

- [Preprint 26] RAGPulse: An Open-Source RAG Workload Trace to Optimize RAG Serving Systems [paper][code][huggingface]

- [Preprint 26] KernelBand: Boosting LLM-based Kernel Optimization with a Hierarchical and Hardware-aware Multi-armed Bandit [paper]

- [Preprint 26] ServerlessLoRA: Minimizing Latency and Cost in Serverless Inference for LoRA-Based LLMs [paper]

荣誉奖励

- 小米学者,小米公益基金会,2026

- 优秀本科毕设指导老师,天津大学,2025

- U35 优秀青年人才奖,天津大学,2025

- 最佳论文奖,SoCC,2024

- 优秀青年学术人才奖,天津大学,2024

- 启明学者,天津大学,2023

- 䇹政学者(交大首位),上海交通大学,2014

- SEIEE 毕业生代表,上海交通大学,2014

教学课程

- 计算机系统基础,天津大学,23年春,24年春,25年春,26年春

- 算法分析与设计,天津大学,23年秋,25年春,26年春

- Introduction to Internetworking,美国南加州大学,16年春

学生

博士生- 赵志新 (2022 - Now)1

- 杨国涛 (2023 - Now)1

- 郑梁 (2024 - Now)2

- 王正超 (2025 - Now)

- 王鑫培 (2026 - Now)

- 龚子淇 (2023 - Now)

- 申晨 (2023 - Now)

- 肖景元 (2024 - Now)

- 易锦均 (2024 - Now)

- 王涛 (2024 - Now)1

- 王永峰 (2025 - Now)

- 陈市 (2025 - Now)

- 回凯宁 (2025 - Now)

- 贺思为 (2025 - Now)

- 叶佳宁 (2025 - Now)

- 史博文 (2025 - Now)

- 谢涵阳 (2025 - Now)

- 郭睿 (2024 - Now)

- 陈昊 (2024 - Now)

- 王鑫培 (2025 - Now)

- 严科 (2025 - Now)

- 赵明熙 (2025 - Now)

- 常竹轩 (2025 - Now)

- 石勇志 (2025 - Now)

- 刘福疆 (2025 - Now)

- 余佳政 (2025 - Now)

- 朱丰凯 (2025 - Now)

- 殷龙飞 (2025 - Now)

- 李昊蓬 (2025 - Now)

- 潘景洋 (2025 - Now)

- 喻新强 (2025 - Now)

- 徐炜博 (2025 - Now)

- 王腾毅 (2025 - Now)

- 郭智柯 (2025 - Now)

- 吴一鹏 (2025 - Now)

毕业生

硕士 本科生- 纪明方 (本科, 2026) → 复旦直博

- 钟震屹 (本科, 2026; 学生科学奖,天大学生科研领域最高荣誉) → 上交直博

- 王科 (本科, 2026) → 上交直博

- 郑君慧 (本科, 2026) → 上交直博

- 曾凯 (本科, 2026) → 北大读研

- 程洋 (本科, 2026) → 清华读研

- 赵浩冉 (本科, 2026) → 复旦读研

- 朱文鑫 (本科, 2025) → 清华读研

- 王永峰 (本科, 2025) → 天大读研

- 陈市 (本科, 2025) → 天大读研

- 王荣伟 (本科, 2024) → 清华读研

- 肖景元 (本科, 2024) → 天大读研

- 龚子淇 (本科, 2023) → 天大读研

- 杨国涛 (本科, 2023) → 天大硕博